(深圳18日综合电)人工智能(AI)在日常生活中的应用越来越多,想像一下,身体不舒服时,在家中先以手机进入医院AI聊天室,输入病征,系统指示你需要看哪一科,并即时排期预约;到看病时,医生已了解你的情况,加快速度对症下药。这个AI聊天室,就是“华佗GPT”了。

据中国媒体报道,“华佗GPT”是由香港中大及深圳市大数据研究院研发,是全球首个ChatGPT医疗领域垂直大模型,在中文医疗场景上,“华佗GPT”比国际知名的GPT-4大模型表现更好。与此同时,“华佗GPT”还是一个免费开源模型,可供直接使用。

ADVERTISEMENT

去年4月,“华佗GPT”开始在龙岗区的公立医院使用,至今该区已有12间公院引入,令龙岗区的医疗AI服务站在全国前列。而最早应用“华佗GPT”智能导诊系统的,是深圳市龙岗区人民医院 (中大(深圳)附属第二医院)。

“华佗GPT”具有智能分诊、预先问诊、健康科普、院内咨询等功能,有效加快患者就医和医生的诊治效率。

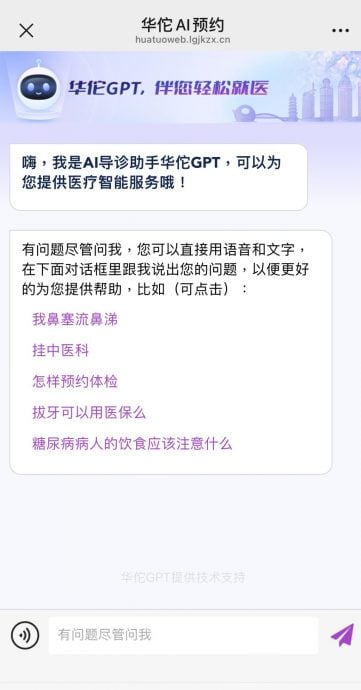

市民经手机进入医院官方微信公众号或“健康龙岗”小程序后,选择“华佗GPT预约”,以文字或语音与系统进行沟通。“华佗GPT”结合AI深度融合自然口语处理技术,能够高度辨识口语,做到流畅地与市民沟通,了解到他们的医疗需要。

例如,老伯伯对“华佗GPT”说:“华佗医生你好,我最近感觉有点喘不上气,血压好像有高,半夜偶尔还会咳嗽,你能给我推荐挂哪一个科吗?”系统能清晰辨认到老伯的口语,与之进行无障碍沟通,提供病症评估、健康咨询,或就医指导,并建议病者该分诊到哪一科。当老伯伯同意后,系统更可以无缝连接挂号,快速完成排期预约,让老伯伯加快得到就医的机会。

目前,华佗GPT的分诊准确率已达95%以上,大幅提升了医疗服务效率。

据香港中文大学(深圳)官网显示,2023年10月,“华佗GPT”已通过国家执业药师考试,以及多个医疗资格考试,且在各项考试和专业评测中取得了优异成绩。

当然,纯粹透过AI不足以为病人确诊断症,但通过系统,病人可以预先具体地写下病征,减少因为面对医生时的感到紧张或尴尬而不能详细描述病况。到应诊时,医生便能初步掌握病者的情况,加快诊断,对症下药,紧抓最佳的治疗时机。

“华佗GPT”是由“90后”的香港中文大学(深圳)数据科学学院助理教授王本友,带领一班平均年龄仅24岁的深圳科研团开发的。除了为病人服务外,王本友还会把“华佗GPT”为医生提供服务,一方面为医生提供辅助诊断,减轻工作量,另一方面则透过大模型赋能的产品培养医学生和医生,为未来医疗作准备。

王本友介绍,作为大模型,“华佗GPT”在诊疗中“不知疲惫”,能够持续保持高水平的准确性和稳定性,为患者提供更加可靠的导诊服务。

ADVERTISEMENT

热门新闻

百格视频

科技本身没有好坏之分,关键在于我们如何选择使用它。一把锤子可以用来建造房屋,也可以用来造成伤害。人工智能也不例外。人工智能的发展不仅要以专业技术为指导,还要以智慧、同理心和深刻的社会责任感为基础。

人工智能(AI)不再是科幻小说中的遥远概念。它就在这里,影响着我们的生活、工作和互动方式。从脸书的面部识别和Netflix的个性化推荐,到医疗诊断和自动驾驶汽车,人工智能已融入现代生活的方方面面。但是,当我们惊叹于它的能力时,一个关键的问题出现了:人工智能为谁的利益服务?如果放任不管,人工智能将成为一种只对少数精英有利的工具,还是能够为人类的共同利益服务?

人性化人工智能的理念正受到越来越多的关注——在这一理念下,人工智能的发展和部署不仅受到经济激励或技术实力的驱动,而且以道德考量为其核心。这意味着要优先考虑公平、透明、问责,最重要的是要考虑人类的福祉。

从历史上看,科技始终是一把双刃剑。印刷使知识民主化,但政治宣传很快随之而来。互联网将世界连接起来,但错误信息也随之泛滥并对我们造成伤害。人工智能也不例外。如果遵循正确的原则,它可以改善我们的生活;如果滥用,它可能扩大不平等,强化偏见,并侵蚀隐私。

阿西莫夫(Isaac Asimov)在他的《机器人》系列中对这一困境进行了广泛的探讨,其中的机器人三定律旨在确保机器人在为人类服务的同时不会造成伤害。然而,即使在这些定律中,阿西莫夫也展示了当人工智能被迫驾驭复杂的人类时所产生的模糊性和道德困境。

许多人认为,开发人工智能是科学家、工程师和技术官僚的唯一责任。然而,人工智能的影响过于巨大,不可能由少数人掌控。每个人,无论是学生、医疗工作者、企业家还是退休人员,都与人工智能的发展息息相关。正如民主的发展离不开公民的参与一样,负责任的人工智能发展也需要公众的醒觉和参与。

人工智能就像阿西莫夫的《基地》系列一样,在预测建模的前提下蓬勃发展,而人类的行为模式可以指导未来。但如果这些模式强化了社会偏见,而不是纠正它们,会发生什么呢?人工智能通常以“黑盒子”的方式运行,在这种情况下做出的决定没有明确的解释。如果人工智能驱动的医疗系统做出了错误的诊断,难道病人和医生不应该有权知道原因吗?人工智能从数据中学习,如果数据有偏差,结果也会有偏差。考虑一下人工智能驱动的招聘系统在某些情况下是如何歧视妇女和少数民族的。确保数据的多样性、包容性和代表性不仅仅是一个技术问题,更是一个社会和道德问题。

政府和企业必须执行使人工智能符合人类价值观的政策。道德准则不应仅仅是建议,而应是保护公众利益的可执行框架。与此同时,数字时代要求我们不仅要消费科技,还要了解其影响。正如金融知识可以帮助人们理财一样,人工智能知识使我们能够批判性地看待影响我们生活的系统。

从早期发现疾病到应对全球气候变化,人工智能在解决现实世界的挑战方面有着巨大的潜力。支持将人工智能用于教育、可持续发展和医疗保健的倡议,可以确保其惠及全人类,而不仅仅是少数人的特权。

科技本身没有好坏之分,关键在于我们如何选择使用它。一把锤子可以用来建造房屋,也可以用来造成伤害。人工智能也不例外。人工智能的发展不仅要以专业技术为指导,还要以智慧、同理心和深刻的社会责任感为基础。

阿西莫夫的《可避免的冲突》描绘了这样一个世界:由人工智能控制的系统管理着经济和全球决策,看似无懈可击,实则巧妙地引导着人类的进程。它提出了一个令人不安的问题:“我们是想要人工智能为我们做出选择,还是想要人工智能帮助我们做出更好的选择?”也许我们应该问的最重要的问题不是人工智能能做什么,而是它应该做什么。我们能否创造出放大而不是削弱我们共同人性的人工智能系统?我们能否确保人工智能成为代际、文化和社区之间的桥梁,而不是分裂的工具?

如果人工智能要成为21世纪的决定性技术,那么我们就必须确保它能反映人类最优秀的品质。这不仅仅是科学家或决策者的责任——集体智慧至关重要。因此,当我们站在这个科技的十字路口时,我们必须扪心自问:是我们在塑造人工智能,还是人工智能在塑造我们?

ADVERTISEMENT